住んでいる地域によっては車を持たなくても不便なく生活できる。

それでも、子どもが生まれるといったライフイベントを経て、車の購入を検討する場面が訪れることはある。

そんなとき、これまで車に興味が無かった場合は、ほとんど知識がゼロの状態から調べることが想定される。

この作業には時間がかかるし、なかなか参考になるまとまった情報も見つかりにくい。

かといって、調査が不足した状況で購入に踏み切ると、後から後悔を招く可能性も高まる。

そこで、この記事では自分が調べたり経験した内容をベースに、検討する上で知っておくと良さそうなことを書き連ねてみる。

この記事の想定読者は次のとおり。

- 車に興味を持ったことがない

- 車の購入を検討している (あるいは今後する予定がある)

- 車を購入する場合には子どもを含む家族で利用する

ここでは車を「時間を選ばずに使える移動手段」や「移動できるプライベート空間」と割り切って捉える。

現時点で車について一定の知識や何らかのこだわりがある人は、それに基づいて検討するだけなので読む必要はない。

また、万人に車の所有をすすめる意図もない。

所有せずに借りて利用する方法として、次のような選択肢も考えられる。

上記でレンタカーやカーシェアリングに関しては導入までのコストが低い。

そのため、利用できるならまずは実際に試してみるのが手っ取り早い。

なお、カーリースについては一定の契約期間や利用する上での条件がある。

また、一般的には中途解約で違約金が生じることから、導入する前にはしっかりと検討した方が良い。

車を借りる場合にも、どんな車種を借りるか選定するタイミングであればこの記事が参考になるかもしれない。

あらかじめ断っておくと、この記事は長い。

もくじ

車種を選ぶ上での基準について

車に興味のない人が最初に悩むことのひとつが、一体どんな車があるのか分からないところだと思う。

そして、調べてもそれぞれにどんな違いがあるのか、それが自分たちに合った車なのかが最初は判断しにくい。

そこで、まずは子どものいる家族が車を選定する上で考慮した方が良さそうなポイントをいくつか挙げていく。

実際のところ、いくつかの視点で絞り込むと車種の選択肢は自然に限られてくる。

この点は、すでに車を利用している別の家族を観察すると、似たような車種が多いことからも実感できる。

話の前提として、すべての面で完璧な車というのは存在しえない。

これは、ある点を重視すると別の点で妥協が必要になるようなトレードオフが生じやすいため。

極端な例を挙げると、スポーツカーは走行性能を上げるために乗員数や室内空間などを重視しない。

つまり、車種の選択は、どういった点を重視してどういった点を妥協するかに依存しやすい。

パワースライドドアの有無

いきなりだけど取り上げたいのがパワースライドドアの有無について。

これには、ショッピングセンターなどの狭い駐車場に車を止めて、子どもを乗り降りさせる場面をイメージしてほしい。

まず、子どもが小さい頃は抱っこしながら車のドアを開閉しなければいけない場面が多い。

このとき、自分たちの車の左右に車が止まっていると、ヒンジドア (一般的な開き戸のタイプ) は片手で開閉するのに苦労する。

さらに、ドアを大きく開けられない場合には、子どもをチャイルドシートへ乗せたり降ろしたりすることに困難を伴うことがある。

また、ヒンジドアは子どもが成長して自分でドアを開けるようになると、隣に駐車している車を傷つけてしまう (ドアパンチという) 可能性が高まる。

パワースライドドアの場合は、ドアノブを引くだけでドアが開く。

また、ドアが丸ごと後ろにスライドして目前からいなくなるので、スペースが狭くても乗せたり降ろしたりしやすい。

ドアパンチのリスクも小さい。

そして、パワースライドドアは子どものいる家族を主要なユーザに想定している車種に装備されやすい。

そのため、ひとまずパワースライドドアのついた車種から選ぶという作戦も取れる。

パワースライドドアのついた車種はそこまで多くないので、これだけでも候補となる車種は減る。

一方で、パワースライドドアの主要なデメリットも挙げておく。

まず、重量がかさむことから燃費に若干の悪影響がある。

また、機構が複雑なので故障したときの修理代は高くなる傾向にある。

車のサイズ

続いては車のサイズについて。

分かりやすいところでは、運転する上で大きなサイズの車は扱いにくいと感じる恐れがある。

この点は、自宅周辺など普段利用する道の広さにも依存する。

また、駐車場によっては駐車できる車のサイズに制約が設けられていることがある。

特に、都市部に多い機械式の立体駐車場には注意を要する。

何故なら、機械式の立体駐車場は高さの制約がきついことがあるため。

たとえば、利用する駐車場に高さ 1550mm 以下という制約があると、先に述べたパワースライドドアを備える車種はほとんど選択肢がなくなってしまう。

また、仮にパワースライドドアをあきらめたとしてもデメリットは残る。

これは、子どものお世話がしやすい室内寸法の大きな車種は必然的に背が高くなる傾向にあるため。

また、平置きの駐車場であっても車のサイズに制約があったり、狭いスペースは軽自動車専用になっていることがある。

そのため、利用する予定の駐車場に止められる車の寸法は少なくとも事前に必ず確認してほしい。

ちなみに、一般的な乗用車には次の 3 種類の規格がある。

それぞれに乗員数や寸法、エンジンの排気量などが定められている。

基本的に上にいくほど小さく、そして諸々のコストが安い傾向にある。

小型自動車と普通自動車は総称して登録(自動)車と呼ぶことがある。

これは、軽自動車とその以外では法律上の扱いが異なっており、登録車は陸運支局への登録が必要になるため。

では単純に車は小さい方が良いのかというと、もちろんそんなことはない。

一度に乗せられる荷物の量が減ったり、あるいは乗れる人数が少なくなるといったデメリットがある。

一度に乗れる人数

サイズと相関しやすいものの、一度に乗れる人数も車選びでは重要なポイントになる。

たとえば、軽自動車であれば規格で乗員は 4 名以下と定められている。

そのため、もし一度に 5 名以上を乗せたいときはそもそも軽自動車は選択肢から外れる。

ちなみに、12 歳未満の子どもは 1.5 人で大人 1 人分の乗員として計算される。

とはいえ、現実的にはチャイルドシートやジュニアシートを使うので大人が座るのと同じ面積を占有する。

また、基本的にチャイルドシートやジュニアシートは助手席に設置することがエアバッグの関係から推奨されていない。

そのため、どの席に家族の誰がどのような形で乗るかは事前に想定しておく必要がある。

もし一度に 6 人以上を乗せたい場合は、一般的に車が 3 列目シートという装備を必要とある。

これは、一般的な乗用車であれば前席 (1列目) と後席 (2列目) だけのところに、さらに後ろに席 (3列目) があるというもの。

この 3 列目シートを備える車種は意外と少ない。

なお、3 列目シートの席は車種によっては次のような制約がある点に注意が必要となる。

- チャイルドシートの設置が難しい場合がある

- 他の席に比べて乗り心地に劣る場合がある

また、一定の人数が乗った状態で荷物がどれくらい乗せられるかも気をつけるべきポイントになる。

特に子どもが小さいときはベビーカーを積む必要があったり、お世話に使う荷物がかさばる傾向にある。

旅行など長距離・長時間の移動においては、特に荷物の積載量が車のボトルネックになりやすい。

子どものお世話のしやすさ

車内において食事 (授乳) や着替え (おむつ交換) など、子どものお世話をする場面がある。

車種によっては、そういった場面を想定して意図的にお世話をしやすく作られている。

代表的なものを挙げると、車内を歩いて移動できるようにしたもの。

これは機能的にはウォークスルーと呼ばれる。

雨が降っているタイミングや、運転手を交代するような場面で使いやすい。

車種によっては 1 列目から 3 列目までウォークスルーできる。

もちろん、単純に室内空間が広かったり天井が高い車種は車内でお世話がしやすい。

この点は、後席がびっくりするほど狭い車種もある 1 ので注意が必要になる。

他にも、細かい所でいうと食事や飲み物を置くためのシートバックテーブルの有無とか。

子どもは暑がりなので、後席にエアコンの送風口やサーキュレーターがあると夏場も涼しく過ごせる。

ただし、ここらへんはあらかじめ車についていなくても、ある程度は自分で工夫して後付けなどをする余地がある。

なお、室内空間が広かったり天井の高い車種のデメリットとしては、重心の高さなどから走行性能の妥協につながりやすい傾向がある。

安全性について

大切な家族を乗せるからには、安全性も気になるポイントのはず。

ここでは、なるべく定量的に評価している資料を参照したい。

まずは独立行政法人 自動車事故対策機構 (NASVA) が実施している自動車アセスメント (JNCAP) がある。

車の安全性は、一般的に予防安全性と衝突安全性に分けて考えられる。

NASVA の自動車アセスメントでは、国内で販売されている主要な車種について予防安全性と衝突安全性を評価している。

国内でのみ販売されている車種については、衝突安全性の評価に関するほとんど唯一の情報源になる 2。

www.nasva.go.jp

一点、衝突安全性の結果を解釈する上で注意すべき点を挙げておく。

それは、前面衝突の評価が「車両単独事故」に相当する条件になっていること。

車両を固定された障害物にぶつけるので、衝突時に車両へかかる運動エネルギーは車両の質量に応じて異なる。

つまり、軽い車両ほど衝突時の運動エネルギーは小さい状況で評価されている。

一方で、側面衝突の評価では止まっている車両に動く車台をぶつけるので車両相互事故に相当する条件になる。

なお、評価項目や内容は定期的に更新されるので、ずっと同じわけではない。

次に、乗用車の種類と死亡事故の相関については公益財団法人 交通事故総合分析センター (ITARDA) の資料がある。

少し古いものの 1999 年に発行された ITARDA INFORMATION No.20 を参照する。

https://www.itarda.or.jp/contents/518/info20.pdfwww.itarda.or.jp

以下は上記の資料から抜粋したもの。

平成 8 年の「車両相互事故」における運転者 1,000 人あたりの死者数を示す。

わずかながら小さい自動車の方が死亡事故が起こりやすい傾向が確認できる。

| 種類 |

ベルト着用 |

ベルト非着用 |

| 軽乗用車 |

1.1 |

12.0 |

| 小型乗用車 |

0.6 |

7.0 |

| 普通乗用車 |

0.4 |

5.1 |

なお「車両単独事故」では、むしろ登録車の方が死亡事故が起こりやすい傾向を示している。

| 種類 |

ベルト着用 |

ベルト非着用 |

| 軽乗用車 |

19.2 |

34.4 |

| 小型乗用車 |

24.8 |

61.3 |

| 普通乗用車 |

23.5 |

96.8 |

資料ではその理由として、普通乗用車は事故直前に出していたスピード (危険認知速度) が速いためと述べられている。

たしかに危険認知速度の累積カーブを見ると軽自動車・小型自動車・普通自動車の順でスピードが速い傾向にある。

運動エネルギーは速度に関して二乗で大きくなるため、車のサイズに関わらずスピードを出すことは危ないと言える。

また、2020 年発行の No.133 では、軽自動車における AEB (衝突被害軽減ブレーキ) についての分析がある。

AEB は先進運転支援システム (ADAS) の一種で、衝突のリスクが高い場合に自動でブレーキをかけてくれる機能のこと。

予防安全性を高める効果や、衝突した際の被害を軽減することが期待できる。

https://www.itarda.or.jp/contents/8685/info133.pdfwww.itarda.or.jp

上記の分析では、軽自動車において AEB が事故の発生率を減少させる効果が示されている。

ここ数年における ADAS の進歩は目覚ましいことから、新しいシステムを搭載した車両を利用するモチベーションにつながる。

ちなみに運転が苦手なときは、今だと駐車を自動でやってくれる車両なんてのもある。

なお、安全性のトレードオフについても言及しておく。

まず、衝突安全性を重視すると室内空間の広さに制約を受けたり、重量が増して燃費に悪影響を与えることが考えられる。

予防安全性については、より高性能な SoC を必要とすることやセンサーの種類や数が増えることで開発・製造のコストに影響してくる。

チャイルドシートの安全性

ちなみに前述の NASVA は国内で販売されている主要なチャイルドシートの安全性や使い勝手に関するアセスメントも実施している。

一見するとどれも大した違いがないように思われるチャイルドシートも、事故が起こった際の安全性に違いがある。

www.nasva.go.jp

また、チャイルドシートは車両に固定する方法として主に以下の 2 種類がある。

- シートベルトを利用するもの

- 国際標準規格の ISOFIX という取付金具を利用するもの

特別な事情が無い限りは、ISOFIX のタイプを選ぶことで確実な固定を得るのがおすすめ。

日本では 2012 年以降に販売される新車に ISOFIX の設置が義務付けられている。

なお、すべての座席に装備されているわけではない点に留意が必要となる。

生涯費用について

続いて、車の所有とは切っても切り離せない関係にあるのがお金の話。

車は購入するのにお金がかかるだけでなく、維持するのにもお金がかかる。

そして、手放すときには大抵の場合にいくらかのお金が戻ってくる。

そこで、これらを合算した金額を生涯費用と捉える。

購入金額と売却金額について

おそらく大抵の人にとって、自動車の購入金額はなるべく抑えたいはず。

ただし、単純に購入金額を抑えれば生涯費用も抑えられるとは限らない。

ここでは、その背景を説明する。

まず、乗用車は中古市場が発達している。

特にコロナ禍以降は、いくつかの理由で中古車の人気が高まっている。

これは、自身が所有している車を業者に売却するときに値段がつきやすいことを意味する。

中古車の値段は、市場の需給バランスで決まる傾向にある。

つまり、需要 (人気) があって、市場への供給が少ない車種ほど値段が高くなる。

たとえば、人気のない車種を選んで購入すると売却金額は低くなりやすい。

そういった事情もあって、購入金額を抑えることが必ずしも長い目で見たとき経済的に合理的とは限らない。

この、車を売却するときの値段の良し悪しは「リセールが良い・悪い (あるいは高い・低い)」と表現する。

中古車の価格を決めるパラメータは多岐にわたる。

車種以外で最も基本的なものとしては「年式」と「走行距離」がある。

乗用車は製造から年数が経つほど、そしてたくさん走るほど価値が落ちていく。

「メーカー」についても、一般的に海外メーカーは国内メーカーに比べて価値の下落が大きい傾向にある。

これは、経年を経たときの故障しやすさが一因として考えられる。

また、乗用車は一般的に数年から十数年ごとにフルモデルチェンジする。

フルモデルチェンジでは、車の見た目や中身がごそっと入れ替わる。

そうなると、型落ちになったモデルは通常であれば人気が落ちるので中古車も安くなる。

上記のような事情から、可能であれば自動車を購入する時点で、ある程度の出口戦略を考えておけると良い。

要するに、購入してから何年程度乗って、手放すときは何万円程度で売れそうかをあらかじめ想定しておく。

もちろんこれは単なる皮算用に過ぎないけど、何もないよりは車に使うお金の計画を立てやすくなる。

その車の実際の生涯費用は、乗り終わって手放したタイミングで確定する。

あとは乗っていた期間で均せば、その車を乗るのに月額でいくらかかっていたかが分かる。

維持費について

車はただ所有しているだけで、乗る乗らないに関わらず維持費がかかる。

ここでは、どういった費用がかかるのか代表的なものを挙げていく。

駐車場代

まず、駐車場がかからない家に住んでいない限りは駐車場代が毎月発生する。

住んでいる土地の値段が高ければ、駐車場の料金もそれに比例して高くなる。

自動車税 / 軽自動車税

1 年に 1 回、車を保有していると税金を支払う必要がある。

登録車は排気量に応じて概ね 3 ~ 4 万円ほどかかる。

軽自動車なら 1 万円で済む。

車検

車は 2 年ごと (新車のみ 3 年) に車検を受けることが義務付けられている。

車検では、その車が保安基準に適合しているかどうか検査される。

車検で必要になる費用は大きく分けて以下の 3 つがある。

法定費用に関しては何処でやってもほとんど差がない。

一方で、検査費用・手数料と整備費用についてはお願いする業者によって変わってくる。

車検には法定費用があるため、検査費用や整備費用を安く抑えても数万円程度は必ずかかる。

また、経年や走行距離が増えるごとに、保安基準に適合させるのに要する整備費用が増える傾向にある。

任意保険

一般的に、自賠責保険 (強制保険) でカバーしきれない部分を補うために任意保険に加入する。

車種や加入する内容に依存するが、これには 1 年間で数万円程度はかかる。

消耗品類

自動車には走行や経年劣化によって定期的に交換を必要とする部品がある。

以下に主だったものを挙げてみる。

それぞれ、交換が必要になったタイミングで数千円から数万円がかかる。

- エンジンオイル・オイルフィルター

- エアコンフィルター

- ワイパーゴム

- 補機用バッテリー

- タイヤ

燃料代・高速道路料金など

これについては言わずもがなで、乗れば乗っただけお金がかかる。

駆動方式について

自動車の駆動方式についても取り上げておく。

色々あって意外とややこしい。

車にこだわりがない場合、動けば何でも良いと思えるかもしれない。

しかしながら、駆動方式は前述した生涯費用に影響するため無視はできない。

なお、現在は特別な事情がない限り基本的にエンジン車かハイブリッド車の 2 種類から選ぶことになる。

駆動方式のスペックに登場する数値に関しては、ざっくり以下のようにイメージしておくと良い。

自宅の近くに坂道が多かったり、高速道路を使う機会があるなら意識した方が良いかも。

エンジン車

エンジン車は、ガソリンや軽油といった燃料を燃やす内燃機関だけで動く自動車のこと。

ハイブリッド車に比べると車体価格が抑えられる一方で燃費や走行性能が劣る傾向にある。

車種によってはエンジンの排気量 (燃焼室の数と大きさの積) や過給器の有無を選べる。

過給器は主にターボチャージャーで、通常はターボと略される。

過給器がついていると、仮想的な排気量を増やす効果がある。

特に、排気量の制約が強い軽自動車の場合は有無を選べることが多い。

過給器がつくと、一般的に出力とトルクが増して、燃費がわずかに落ちる傾向にある。

ハイブリッド車 (HV)

エンジンに加えてモーターで駆動する力も使う自動車をハイブリッド車と呼ぶ。

エンジン車に比べると燃費が良く、静粛性や走行性能に優れる傾向にある。

なお、燃費の差で車両価格の差額分の元を取るには長い距離 (典型的には 10 万キロなど) を乗る必要がある。

そのため、元を取るというよりはその他の観点 (静粛性、スペック、リセール、給油間隔など) で選ぶ方が現実的に感じる。

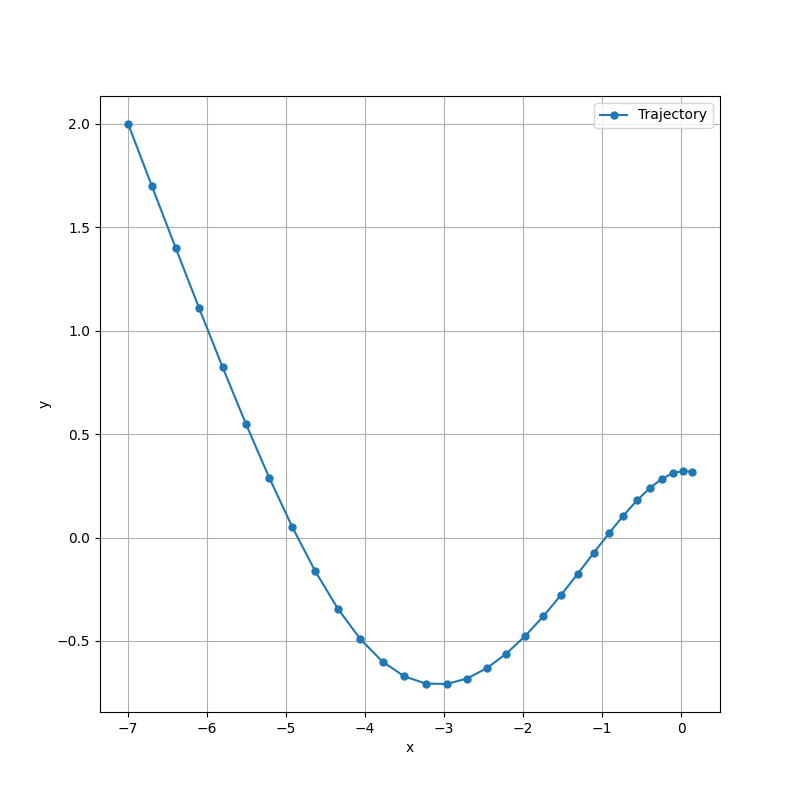

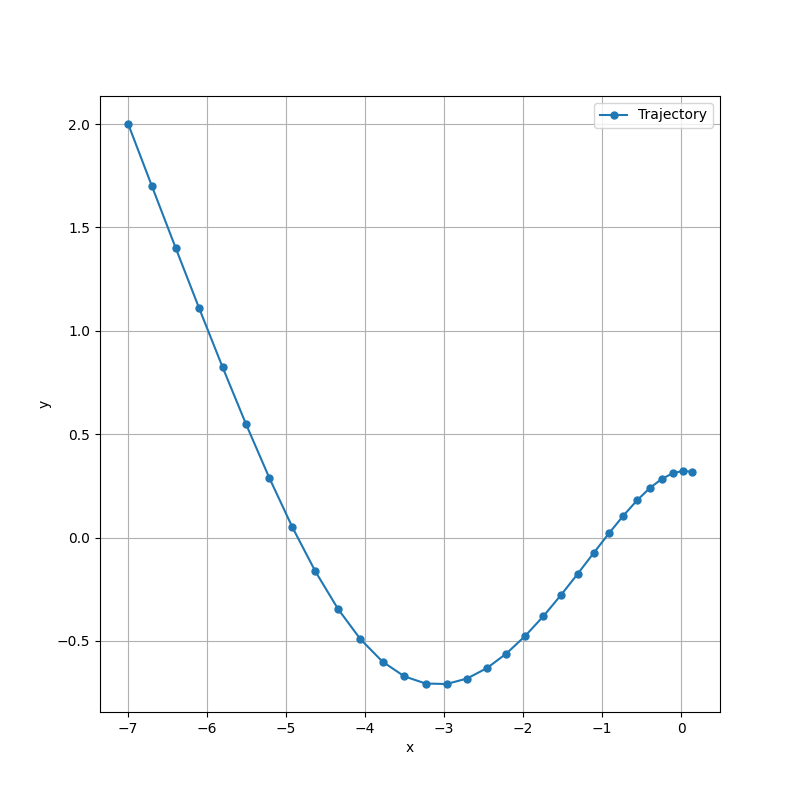

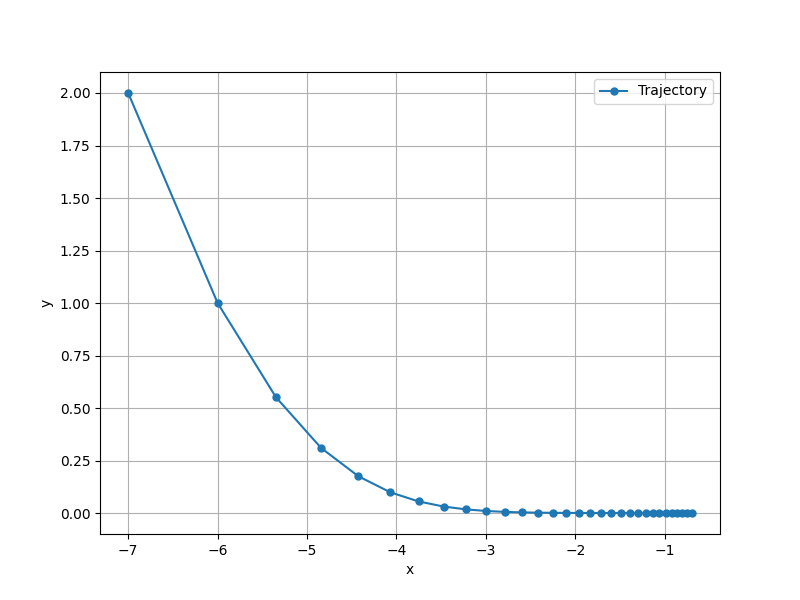

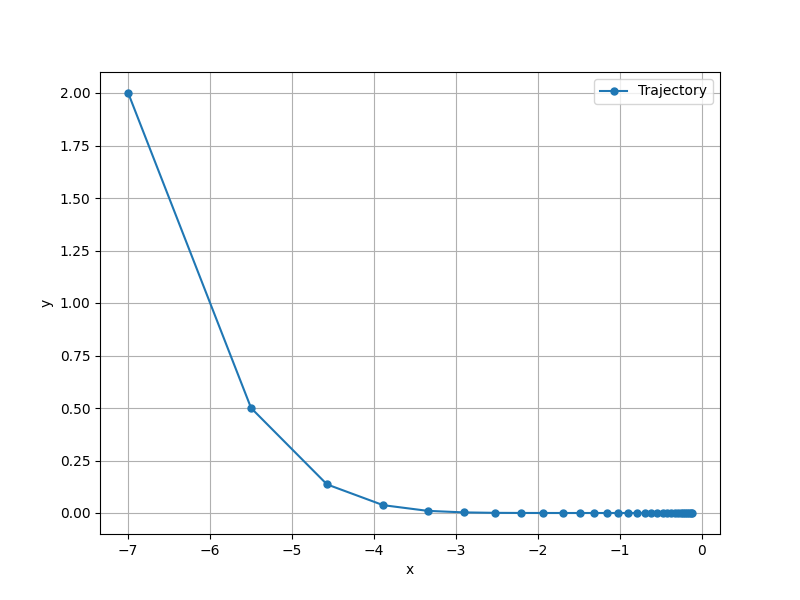

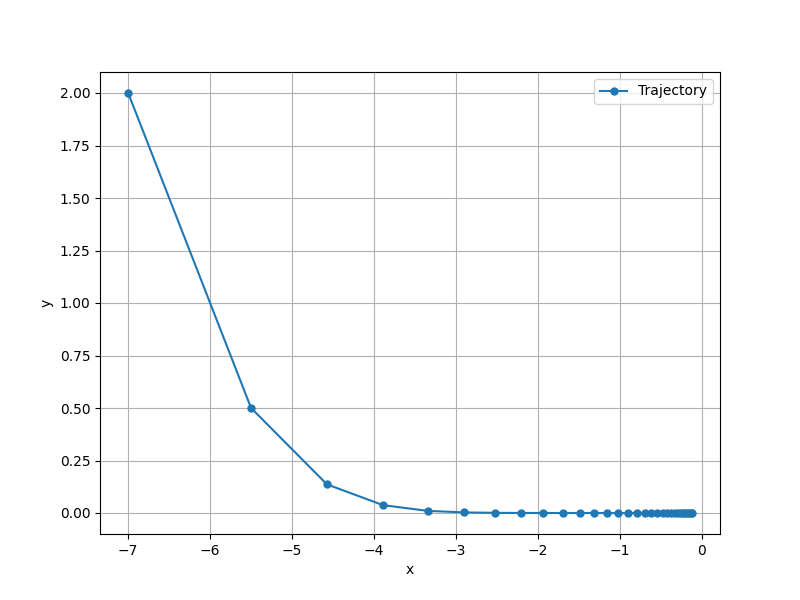

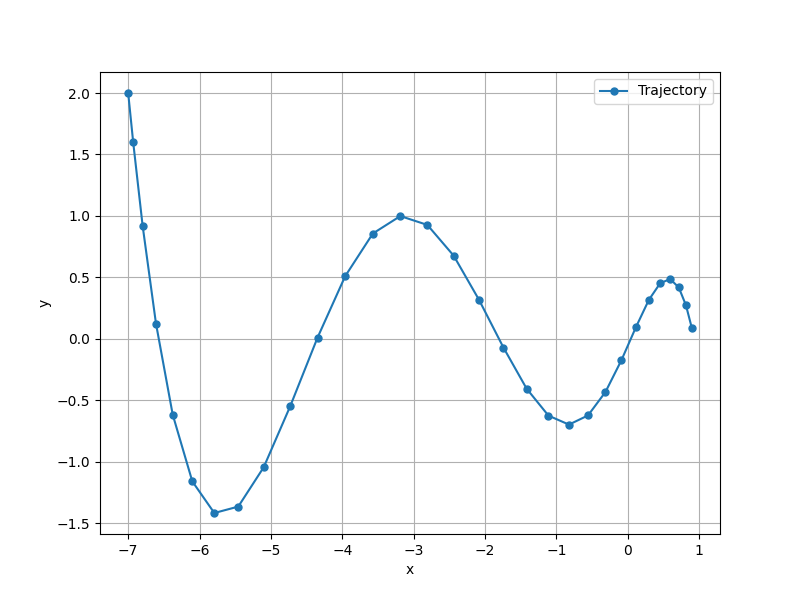

参考までに、元を取るまでの距離を求める方法を示す。

まず、使用するパラメータは次のとおり。

- ハイブリッド車の車両価格 (円)

- エンジン車の車両価格 (円)

- ハイブリッド車の燃費 (km/L)

- エンジン車の燃費 (km/L)

- 燃料費 (円/L)

まずは車両の価格差  (円) を求める。

(円) を求める。

1km あたりの燃料費の差  (円/km) を求める。

(円/km) を求める。

元が取れる走行距離  (km) を求める

(km) を求める

ちなみに、ハイブリッド車にはシステムの電圧が低い「マイルドハイブリッド」と電圧が高い「ストロングハイブリッド」の 2 種類がある。

いずれにしても、エンジンとは別にモーターや駆動用バッテリーが必要になるためエンジン車に比べると価格は高い。

マイルドハイブリッドは、モーターの出力やトルクが低い。

そのため、発進時などエンジンが苦手とする場面をモーターでアシストする側面が強い。

価格やサイズの制約が強い軽自動車であってもマイルドハイブリッドならラインナップがある。

燃費を改善する効果は相対的に小さい (エンジン車に比べて 115% など)。

ストロングハイブリッドは、モーターの出力やトルクが高い。

そのため、エンジンは発電に徹してモーターのみで駆動するようなシステム構成 (シリーズ型ハイブリッド) すらある。

燃費を改善する効果は相対的に大きい (エンジン車に比べて 150% など)。

また、バッテリーのエネルギーだけで走れる距離を数十キロメートル程度まで伸ばしたプラグインハイブリッド (PHV) という派生形もある。

これはハイブリッドと電気自動車の中間のような存在で、車両価格はストロングハイブリッドよりもさらに高い。

電気自動車 (BEV)

バッテリーに貯めた電力とモーターのみで駆動する自動車を電気自動車と呼ぶ。

現状では内燃機関を積んだ車に対するメリットはさほどない割にデメリットは多い。

- エネルギーの補充 (充電) に時間がかかる

- エネルギーを補充できる場所が限られる

- バッテリーが劣化すると航続距離が短くなる

- 車両価格が高い

- リセールが低い

何らかのこだわりがある場合を除いて、今のところ有効な選択肢となる場面は限られる。

燃料電池車 (FCV)

燃料 (一般的に水素) を電気化学反応させて取り出した電気でモーターを動かす自動車を燃料電池車と呼ぶ。

電気自動車と同様に、現時点で積極的に選ぶ理由には乏しい。

車種の具体例について

ここまでは選定基準などを挙げてきた。

具体的な話もした方が良いと思うので、以下の基準で車種をいくつか挙げてみる。

- パワースライドドアを装備している

- 室内空間が広い

- 販売台数が多い

- 国内メーカーが製造している

なお、新車の販売台数に関する統計情報は以下の Web サイトで確認できる。

こちらが軽自動車。

www.zenkeijikyo.or.jp

こちらが登録車。

www.jada.or.jp

以降は車種を挙げる際に、この記事を書いている時点における直近の販売台数で降順ソートしている。

軽自動車

軽自動車は車両価格が安くて維持費も低い。

乗員数が 4 名であることや、荷物がそんなに載らないことを許容できれば良い選択肢になるはず。

サイズが小さくて運転もしやすいので、最初の一台として選びやすい。

以下は軽のスーパーハイトワゴンと呼ばれるタイプで販売台数の多いモデルになる。

軽自動車の規格をギリギリまで使った上で、大きな室内空間を実現している。

- ホンダ N-BOX

- スズキ スペーシア

- ダイハツ タント

5人乗り

一般的な乗用車において 5 人乗りは車種の選択肢が最も多い。

しかしながら、前述の条件を満たすものは意外と限られる。

以下は小型のハイトワゴンと呼ばれるタイプの車になる。

前述した軽のスーパーハイトワゴンを、そのまま幅と長さについて大きくしたイメージに近い。

なお、トヨタ ルーミーに関してはダイハツ トールの OEM モデルになっている。

これは、別のメーカーが開発した車種を自社のブランドで売るというもの。

6人以上

6 人以上が乗れる乗用車は基本的には 3 列目シートを備えることになる。

次のようなニーズで行き着きやすい。

- 子どもが2人以上いる

- 知人や両親を乗せる機会がある

- 荷物をたくさん載せたい

まずはコンパクトミニバンや S サイズミニバンと呼ばれるタイプ。

一般的な乗用車と大して変わらないサイズで 3 列目シートを備えている。

さすがに 3 列目は狭いので、長時間の利用はつらい感じ。

普段は 3 列目の席を折りたたんでおいて、いざという時だけ使うイメージ。

もう少し大きな、ミニバンや M サイズミニバンと呼ばれるタイプ。

これくらいのサイズになると 3 列目の席にも余裕があるので常用しやすい。

子どもが 3 人以上いるような家庭ではかなりの確率で選ばれる。

- トヨタ ノア・ヴォクシー

- ホンダ ステップワゴン

- 日産 セレナ

なお、上記よりもさらに大きな L サイズミニバンと呼ばれるタイプもある。

とはいえ、この記事の想定読者が最初に検討するような車ではないように思う。

購入までの流れ

ここからは、実際に購入するまでの注意点などを挙げていく。

新車の場合

新車を購入する場合には、基本的にディーラー (販売代理店) へ行くことになる。

ディーラーに行くと待ち時間が多く入るので、滞在時間として半日程度は見積もっておいた方が良い。

あるいは用事があるなどして手早く済ませたい場合には、あらかじめ滞在時間について何時までと事前に伝える。

子どもが同伴するならキッズスペースの有無などを事前に確認しておくと良い。

また、店舗によって用意されている展示車・試乗車の種類や数は異なる。

そのため、確認したい車が揃っている店舗を事前に Web サイトで調べた上で予約を入れておくと間違いがない。

現地では、担当者からヒアリングなどを受けながら展示車の確認や試乗車の試乗を進める。

ちなみに、ディーラーで試乗したり実物を見学できる正味の時間は意外と短い。

試乗に関しては、基本的にはあらかじめ決まったコースをぐるっと数分走るだけ。

この点は、あらかじめこういった道を走りたいなどの希望があれば担当者に伝えることで多少の融通が効く。

とはいえ、高速道路を試乗したいといった要望は、おそらく実現が難しい場合が多いはず。

もし、長い時間をかけて色々な状況で確認したい場合には、ディーラーではなく自分でレンタカーを借りるなどした方が良い。

そして、試乗などが一通り終わると基本的には見積もりを作ってもらうことになる。

見積もりを作る際には、以下のような項目を担当者と話し合いながら決めていく。

なお、見積もり価格の感覚を得るために、事前にメーカーの Web サイトでセルフ見積もりはやっておいた方が良い。

- 車種

- グレード

- 色 (外装・内装)

- オプション

- 支払い方法

見積もりが出たら、あとは帰るなり、見積もりを元にさらに商談を進めるなりの選択肢がある。

とはいえ、いきなり商談を進めるよりは、ひとまず一旦は帰って冷静に検討することをおすすめしたい。

商談を進めるにしても、少なくとも一回目の見積もりで購入することは、次のような理由から避けた方が良い。

- 必要ないオプションが入っている可能性が高い

- 十分な値引きが入っていない可能性が高い

帰る前には、営業活動に対する自分のスタンスを担当者へ明確に伝えておいた方が良い。

具体的には、ディーラーからの自発的な営業活動を受け入れるかどうか。

もし受け入れるなら、どのようなチャネル (電話、郵便など) を受けるか。

また、連絡しても良い時間帯などについても伝えておいた方が良い。

この点を明確に伝えていなかったとき、アポなしで自宅に訪問を受けるようなパターンも実際に経験したことがある。

もし、自身の意思にそぐわないような営業活動を受けるときは取引しないことをおすすめする。

ちなみに、ディーラーは名前が違えば基本的には違う会社が経営している。

また、メーカーとディーラーの間に直接の資本関係がないことも多い。

これは、メーカーとはまったく別の企業が販売代理店の契約を結んでそのメーカーの車を売っているパターン。

ちなみに経営が別の会社であれば、同じ車種であっても相見積もりを取って個別の商談が可能になる。

新車の場合、値引きが期待できる余地は中古車に比べると大きい。

値引きできる相場は車種や市況によって異なるため、あらかじめ調べた方が良い。

中古車の場合

続いては中古車を購入する場合について。

中古車は出物次第なので、基本的には中古車情報を扱っている Web サイトで条件に一致するものを探す場合が多い。

販売されている店舗の場所の兼ね合いもあるので、検索する際は直接訪問できる範囲に絞った方が良い。

気に入ったものがあれば、基本的には現地に赴いて状態の確認や試乗をした上で購入する。

中古車は一定期間で故障した際に保証される範囲が新車に比べると限られる傾向にある。

そういったリスクが気になるときはメーカーの認定中古車を選ぶと良い。

これには、次のようなメリットが考えられる。

- 整備が行き届いた状態で販売される

- メーカーによる認定プロセスがある

- 保証期間が長い (1 年など)

デメリットとしては、その分だけ値段は高くなる。

それ以外だと、次のような策が考えられる。

- 第三者機関による鑑定書がついた車両を選ぶ

- 信頼できる販売店があるならそこで購入する

- 料金を支払って追加の保証をつける

中古車の場合、値引きが期待できる余地は新車に比べると小さい。

これは、それぞれの車両ごとに査定に応じた値付けがされているため。

中古だとまったく同じ状態の商品は 2 つとして無いので、基本的には相場に応じた金額がつけられる。

そのため、現金での値引きを期待するよりは何かをオマケで付けてもらったりするイメージがある。

オプションについて

車には、車両本体とは別にオプションと呼ばれる装備を有料でつけることができる。

オプションには、メーカーオプションとディーラーオプションの 2 種類がある。

前述した通り、ディーラーでの一回目の見積もり内容には大きな利幅を期待できるオプションがいつの間にか含まれていることが多い。

具体的には、メンテナンスパックやガラスコーティングなど。

調べた上で、本当に必要と感じない限りは見積もりから外してもらった方が良い。

なお、オプションはたくさん付けてもリセールの金額には影響しにくい。

プラスに影響するものは、その車種で人気のある一部の装備に限られる。

具体例を挙げると大型のモニターを備えたカーナビゲーションや後席モニター、あるいはサンルーフなど。

メーカーオプション

メーカーオプションは、車両を製造するタイミングで装着される。

そのため、購入した後に追加で装着することは基本的にできない。

装着できるオプションの具体的な内容は、車種やグレードによって異なる。

例を挙げると全周囲カメラやディスプレイオーディオなどがラインナップされることがある。

ディーラーオプション

ディーラーオプションは、任意のタイミングで付け外しできる。

そのため、必要になったら後で追加すれば良い。

中古車であっても、ディーラーなどに持ち込んで装着してもらうことができる。

ただし、新車で購入するタイミングでつけると、金額に応じた一定の値引きが期待できる。

何をオプションにラインナップするかは、メーカーの方針によるところが大きい。

代表的なものをいくつか挙げてみる。

- ドアバイザー

- フロアマット

- カーナビゲーション

- ドライブレコーダー

ちなみに、ディーラーオプションになっている装備は、メーカーの純正ではない「社外品」が存在することも多い。

一般的に社外品は純正品よりも値段が安く、電子機器 (ドライブレコーダーなど) は純正品よりも高性能・多機能な場合が多い。

ただし、取り付けの手間や工賃が別にかかるなど、利用する上で何かしらのトレードオフは必ずある。

グレードについて

同じ名前の車種であっても、いくつかのグレードがラインナップされることが多い。

典型的には、それぞれのグレードで次のような点に違いが設けられている。

注意点としては、人気の集まりやすいグレードがあること。

前述した通り、リセールは需給バランスに応じて決まりやすい。

そのため、グレードによる人気の違いがリセールに影響することも頭の片隅に置いた方が良い。

たとえば軽自動車にはクール系やカスタム系と呼ばれる主に内外装を変えたグレードがよく用意される。

一般的にノーマルのグレードより価格は高いが、差額をリセールで相殺できる可能性がある。

内外装の色について

外装色は複数の色から選べることが多い。

また、車種やグレードによっては内装色も選べることがある。

もちろん好きな色を選んだら良いんだけど、選ぶ上で知っておいた方が良さそうな話もある。

まず、色はリセールに影響する。

車種やグレードにも依存するものの、一般的には外装色は白と黒のリセールが高い場合が多い。

これは、人気のある色に偏りがあることが一因として考えられる。

影響する度合いとしては、人気の有無で 5 ~ 20 万円程度は売却するときの値段が変わってくるイメージ。

また、色はキズや汚れの目立ち方に影響する。

外装色の白と黒であれば、白の方がキズや汚れは目立ちにくいと言われている。

一方で、内装色に関しては黒の方がキズや汚れは目立ちにくいと言われている。

最後に、外装色は夜間における他車や歩行者からの視認性に影響する。

理由は単純で、明るい色の方が光を反射するので暗い場所でも目立ちやすい。

定量的な資料は持ち合わせていないけど、他車や歩行者からの視認性は地味に安全性に関わるポイントになる。

支払い方法について

車を買うときは、その支払い方法にいくつか選択肢がある。

まず一番分かりやすいのが現金払い。

これは、特定の期日までに現金を販売店に持参するか、あるいは銀行振込する。

一度にまとまった金額の現金は必要になるが、支払ってしまえば後は気にすることが何も無い。

次に、自動車ローンを組むやり方。

これは、自動車を買うための資金を何処からか借りて販売店に支払う。

そして、借りたところへ 5 ~ 10 年程度かけてお金を返していく。

自動車ローンを扱っている業者はディーラーや銀行など色々とある。

一般的には銀行などの方が金利が低い。

ローンによってはお金を返し終わるまで車の所有者が自身にならないことがある。

一度にまとまった金額を用意する必要がないので、金利が低ければその分を別の運用に回すなども考えられる。

そして、残価設定型クレジットを利用するやり方。

これは、あらかじめ契約で決まった期間について、特定の金額を支払って車を使用する。

そして、契約期間が満了したタイミングで「買い取り」「乗り換え」「返却」を選ぶ。

返却や乗り換えを選ぶ場合には、基本的に契約で大きなキズのないことや月あたりの走行距離などに一定の条件がある。

条件を満たさない場合には追加でお金を支払う必要がある。

所有者が自身にならないことが多いなど、制度的にはカーリースに近い。

この支払い方法は、ディーラーにとって期待できる利益が大きいことから積極的にすすめられることがある。

まとめ

ここまで、車に興味の無かった人がファミリーカーを検討する上で知っておいた方が良さそうなことを書き連ねてみた。

なお、冒頭に書いた「車に興味の無かった人」というのは、これを書いた自分自身のことを指している。

そのため、自分があらかじめ知っておきたかったと思える内容をできるだけ書いたつもり。

記事の中に誤りを見つけた際にはどうかやさしく教えてほしい。